J'ai une mémoire photographique, et je suis un synesthète spatio-temporel. Cela signifie que je peux visualiser, avec des détails photoréalistes, pratiquement tous les endroits où je suis allé. Je peux aussi imaginer des lieux inexistants et m'y déplacer dans mon esprit comme si j'étais dans un jeu vidéo.

C'est cool d'être capable de faire ça pour soi-même, et la capacité d'imaginer une photo particulière à l'avance m'est utile dans ma carrière de photographe. J'aimerais partager ces images mentales avec d'autres, mais il y a un hic : Je suis nul en dessin. Je peux imaginer un lieu comme la cathédrale de Notre-Dame ou l'intérieur de mon premier appartement avec des détails précis, mais si je prends un stylo et que j'essaie de dessiner ce que je vois dans mon esprit, le résultat ressemble aux gribouillages amusants et sans but d'un enfant de deux ans.

J'ai donc été enthousiasmé d'apprendre que des chercheurs de l'université de Kyoto avaient mis au point un système d'intelligence artificielle capable d'accomplir quelque chose de remarquable : Grâce aux percées réalisées dans le domaine de l'apprentissage profond et des réseaux génératifs, ce système peut lire les images qu'une personne voit dans son esprit et les transformer en photographies numériques avec une précision pouvant atteindre 99 %.

Le système fonctionne pour les images que la personne voit devant ses yeux et pour celles qu'elle imagine. Pour l'instant, les images sont de faible résolution et le sujet doit se trouver dans une machine IRM pour que le système fonctionne. Mais cela laisse entrevoir une possibilité étonnante, que je ne m'attendais pas à voir de mon vivant : à mesure que la technologie s'améliorera et que le matériel de lecture du cerveau se perfectionnera, les ordinateurs pourront scanner nos cerveaux et transformer nos images mentales en photos réelles que nous pourrons enregistrer et partager. Et cela pourrait arriver d'ici une décennie.

Les chercheurs de l'université de Kyoto ont réalisé leurs expériences en 2018 et ont publié les résultats dans la revue PLOS Computational Biology en 2019. Un article paru en 2018 dans le magazine Science détaille le fonctionnement du système des chercheurs. Les chercheurs ont placé les sujets dans un scanner IRMf et ont enregistré l'activité dans leur cerveau. Contrairement à une IRM traditionnelle, une IRMf mesure le flux sanguin dans le cerveau, ce qui permet aux scientifiques de déterminer quelles régions du cerveau sont les plus actives lorsqu'un sujet effectue une tâche. Tout en enregistrant les signaux cérébraux provenant du système visuel des sujets, les chercheurs leur ont montré des milliers d'images, en affichant chaque image plusieurs fois. Ils ont ainsi obtenu une énorme base de données de signaux cérébraux, chaque ensemble de signaux correspondant à une image spécifique.

Les chercheurs ont ensuite introduit toutes ces données dans un réseau neuronal profond (DNN), qu'ils ont entraîné à produire des images. Les réseaux neuronaux sont de fantastiques détecteurs de modèles et, pour chaque photo montrée aux sujets, les chercheurs ont demandé au réseau neuronal de tenter de produire une image correspondant aux modèles d'activité cérébrale observés, en affinant son résultat plus de 200 fois. Le résultat final était un système capable de prendre des données IRMf montrant l'activité cérébrale d'un sujet et de produire une image basée sur ce que le système pensait que le sujet voyait.

Les chercheurs ont ensuite ajouté un élément nouveau : ils ont transmis la sortie du DNN à un réseau génératif déjà entraîné. Ce type de réseau est relativement nouveau et constitue l'une des avancées les plus intéressantes en matière d'intelligence artificielle au cours de la dernière décennie. Ces réseaux neuronaux spécialisés prennent des données de base et génèrent des photos et des vidéos entièrement nouvelles, qui peuvent être remarquablement réalistes. Les réseaux génératifs sont la technologie à l'origine des "deepfakes", des personnes artificielles et de nombreux filtres Snapchat. Dans ce cas, les chercheurs ont utilisé leur réseau génératif pour normaliser les images lues dans le cerveau de leurs sujets et les rendre plus ressemblantes à des photos.

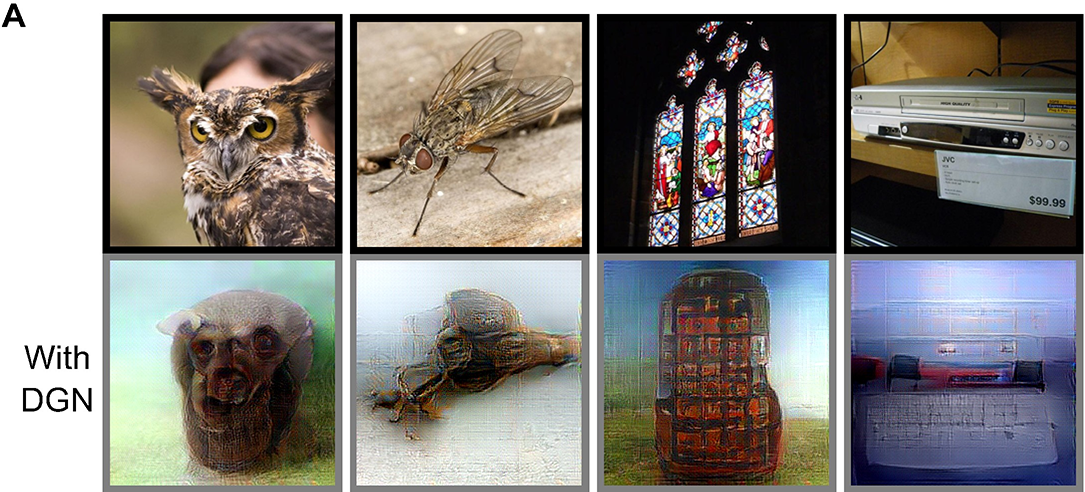

Le système final des chercheurs a pris les données d'activité cérébrale des sujets, les a transformées en photos grossières avec le DNN, puis a utilisé le réseau génératif pour polir ces photos et en faire quelque chose de beaucoup plus réaliste. Pour tester les résultats du système, les chercheurs ont montré les images générées à un ensemble de juges humains. Ils ont également montré aux juges une série d'images d'entrée possibles et leur ont demandé de faire correspondre les images lues dans le cerveau des sujets à l'image d'entrée la plus similaire.

Dans plus de 99 % des cas, les juges ont fait correspondre l'image de sortie produite par le système à l'image d'entrée réelle que le sujet avait regardée. C'est un résultat stupéfiant : En utilisant uniquement les signaux du cerveau et l'IA, les chercheurs ont reconstruit les images dans le cerveau des sujets si bien que des juges humains neutres ont pu les faire correspondre à des images du monde réel dans presque 100 % des cas.

Vous pouvez juger les résultats par vous-même. La première rangée d'images ci-dessous montre les photos originales montrées aux sujets de l'expérience. La deuxième rangée montre les images reconstruites à partir des signaux du cerveau. Elles ne sont pas parfaites, loin de là, mais elles sont tout à fait reconnaissables.

Les chercheurs ont ensuite fait monter les enchères. Au lieu de lire le cerveau des sujets pendant qu'ils regardaient une image, ils leur ont demandé d'imaginer une image qu'ils avaient déjà vue et de la garder dans leur esprit. Les scans cérébraux effectués à partir de cette tâche ont à nouveau donné des images utilisables. (Cela est logique, car imaginer des images fait appel à plusieurs des mêmes régions du cerveau que la visualisation d'images réelles).

Les images construites uniquement à partir de l'imagination étaient loin d'être aussi bonnes que celles créées lorsque les sujets regardaient une photo réelle. Mais lorsqu'on a demandé aux sujets d'imaginer des formes simples et très contrastées, comme un signe plus ou un cercle sur un fond blanc, et que leur cerveau a été scanné, les images reconstruites qui en ont résulté correspondaient à 83,2 % aux exemples du monde réel, soit bien mieux que le hasard.

La difficulté de lire des photos imaginaires a peut-être moins à voir avec les techniques utilisées par les chercheurs qu'avec les sujets. Il est difficile de garder une seule image à l'esprit pendant une longue période, et le degré de photoréalisme de la mémoire varie considérablement d'une personne à l'autre. Si les chercheurs entraînaient les sujets à visualiser des images spécifiques - peut-être en utilisant des techniques dérivées de la méditation - ou s'ils utilisaient des synesthètes comme moi, qui ont souvent une imagerie mentale extrêmement vive (le terme technique est hyperphantasie), ils pourraient obtenir de bien meilleurs résultats.

Pour l'instant, les images dérivées des signaux neuronaux des sujets sont relativement grossières. Mais les premières photographies numériques l'étaient aussi. Les résultats des chercheurs prouvent qu'il est possible de lire des images à partir du cerveau des gens. Maintenant que le chat est sorti du sac, la technologie pourrait s'améliorer de diverses manières, et rapidement.

Tout d'abord, la résolution des données d'entrée pourrait être améliorée de façon spectaculaire. Le protocole d'IRMf utilisé par les chercheurs a donné une résolution spatiale d'environ deux millimètres. Ce n'est pas mal, mais cela signifie tout de même que les chercheurs ont agrégé les réponses d'environ 100 000 neurones dans chaque point de données qu'ils ont mesuré. Les implants cérébraux, comme le dispositif expérimental de Neuralink d'Elon Musk, promettent de lire les réponses de chaque neurone, soit une résolution bien supérieure à celle de l'IRMf.

Cette très haute résolution nécessite actuellement un implant cérébral invasif. Il est toutefois possible qu'avec l'amélioration des réseaux neuronaux profonds, les chercheurs puissent obtenir des données similaires à l'aide d'interfaces cérébrales non invasives et faciles à porter, comme les EEG. Actuellement, les EEG ont une résolution de l'ordre du centimètre, mais les nouvelles technologies optiques permettent d'améliorer cette résolution, et le couplage des EEG avec des réseaux neuronaux à super-résolution améliore considérablement leur résolution effective. Avec l'amélioration des EEG et des réseaux profonds, les logiciels pourraient lire les images du cerveau à l'aide d'un appareil grand public non invasif monté sur la tête d'un utilisateur, tout en obtenant une meilleure résolution que les IRMf actuelles. Une résolution plus élevée donnerait un aperçu plus précis de l'esprit d'un sujet et permettrait à un ordinateur de reconstruire plus facilement ses images mentales.

Si un réseau comme Dall-E pouvait être entraîné à utiliser des données cérébrales plutôt que du texte en entrée, il pourrait probablement prendre les plus infimes schémas d'activation cérébrale et déterminer l'image mentale exacte qu'une personne a en tête. Pour ce faire, il faudrait recueillir une grande quantité de données d'entraînement, c'est-à-dire demander aux gens d'imaginer des millions de photos différentes tout en enregistrant leurs signaux cérébraux pour que le réseau puisse les analyser. Si cette collecte de données peut être effectuée - et si les réseaux génératifs continuent de s'améliorer - il est concevable qu'une interface cérébrale non invasive destinée au grand public puisse lire des images précises dans votre tête d'ici dix ans.

Si cela se produit, les implications seront énormes. Les domaines artistiques et de la conception se transformeraient radicalement. Imaginez que vous puissiez penser à votre vision de la cuisine parfaite (ou de l'interface utilisateur parfaite pour l'application de votre startup) et qu'un ordinateur transforme vos idées en une photo réaliste. Vous pourriez remettre la photo à un architecte ou à un promoteur et faire construire l'espace de vos rêves selon vos caractéristiques exactes et imaginées.

Les photographes pourraient ne plus avoir besoin d'appareils photo : il suffirait de prendre des "images mentales" d'une scène et de les télécharger à loisir depuis notre cerveau. Les concepteurs de produits pourraient créer des maquettes d'un nouvel appareil dans leur cerveau, les capturer et les transformer en modèles réels avec une imprimante 3D. Les réalisateurs pourraient imaginer une scène de film, puis créer des story-boards à partir d'images cérébrales, ou même imaginer et capturer des films d'animation entiers.

Une telle technologie pourrait également constituer un avantage considérable pour les droits de l'homme. Imaginez une situation où la victime d'un massacre ou d'une persécution de masse pourrait se souvenir de ses expériences et voir ses souvenirs transformés en images réelles, qui pourraient ensuite être utilisées pour aider à traduire les auteurs en justice. Les questions relatives à la véracité des images seraient nombreuses, mais la possibilité de capturer des images vivantes de crimes et d'injustices aurait d'énormes répercussions sur le droit.

Il y aurait également de nombreuses applications militaires potentiellement troublantes. Imaginez l'utilisation de cette technologie lors d'un interrogatoire pour extraire les visages d'agents ennemis de l'esprit d'un prisonnier sans son consentement. Ou encore, imaginez qu'une agence de renseignement envoie un espion se promener dans une installation, déguisé en touriste ou en entrepreneur, et qu'il télécharge ensuite de son cerveau des images de l'installation pour en créer un plan détaillé, afin de mieux guider une frappe militaire.

Au niveau personnel, un dispositif conçu pour lire les images de votre cerveau présente des implications évidentes en matière de confidentialité et de sécurité. Ces implications seraient probablement plus alarmantes si la technologie était combinée à un implant cérébral toujours actif, comme celui de Neuralink, puisque l'appareil pourrait lire les images de votre cerveau à tout moment sans que vous le sachiez. Des implémentations plus complexes de la technologie seraient probablement plus sûres - si vous deviez mettre une casquette spéciale (ou vous glisser dans une IRMf) pour que votre cerveau soit lu, il serait au moins évident que vos pensées soient enregistrées.

On peut toujours imaginer des situations embarrassantes découlant d'une machine à lire le cerveau. Imaginez que vous êtes le sujet d'une expérience de laboratoire et que l'on vous demande d'imaginer quelque chose d'inoffensif, comme un nouveau type de téléphone portable, et que vous imaginez plutôt quelque chose d'embarrassant, comme le chercheur principal en sous-vêtements. Selon l'effet de l'ours blanc, plus vous vous efforcez de ne pas imaginer quelque chose, plus il est probable que cette image apparaisse dans votre cerveau. Peut-être que la lecture des pensées est mieux faite en privé.

En tant que personne qui vit déjà le monde de manière extrêmement visuelle, j'attends avec impatience l'arrivée de ces technologies. Les chercheurs ont publié le code de leur système sur Github. Si vous disposez d'un scanner IRMf de 5 millions de dollars chez vous, vous pouvez commencer à lire dans les pensées dès maintenant. Sinon, pour jouer vous-même avec cette technologie, vous devrez probablement attendre que quelqu'un associe des réseaux génératifs puissants à des interfaces cérébrales grand public. Ou, je suppose, vous pourriez renoncer et prendre des cours de dessin.

source :

https://onezero.medium.com/computers-will-be-able-to-read-images-from-your-brain-within-a-decade-be62015891ef

Enregistrer un commentaire

Les commentaires sont validés manuellement avant publication. Il est normal que ceux-ci n'apparaissent pas immédiatement.